去年10月的某天,Cher Scarlett的脸书上收到一条通知,

脸书提醒她说,系统自动识别到有用户上传了一张含有她的照片。

这是一项现在已经被禁止的功能,

但在当时,只要用户开启了自动面部识别选项,

脸书一旦在照片中识别出了这一用户的面孔,就会给他们发送通知。

Cher Scarlett

圈出她的是一张看上去非常陈旧的黑白照片,

发布者是Cher朋友的朋友,也是她的远房亲戚,

她并不认识那个被系统误认成是她的女人,但也觉得那人的眉眼和自己非常相似,

她跑去祖谱网站上查了查信息,没想到,两个人真的有血缘关系,

照片上那个女人,算一算,应该是她的曾曾曾祖母。

这件事激起了Cher对于人脸识别技术的兴趣,

她本就是一个技术大牛,

又因在苹果工作时遭到不平等待遇,发起抗议薪酬透明度和工作环境问题的#AppleToo运动出名,频繁接到记者采访。

今年年初,Cher将自己神奇体验分享出来,

于是,有人与她分享了一个专门用于人脸识别的网站,

这一网站建立的初衷是为了帮助制止报复性色情和身份盗窃等行为,

它使用起来非常简单,只要把一张有着清晰正脸的人物照片放进去,引擎就会自动搜索出此人在其他网站上的照片(不包括社交媒体)。

Cher没想这么多,她只是想看看,系统会不会也把妈妈和女儿的照片误认成她,

于是,她先把10几岁女儿的照片传了上去,但没搜出什么,只看到了一群她不认识的孩子,

然后,Cher又拿妈妈的照片试了试,这回搜出来的倒是妈妈本人,还有一些和她长得像的人,

不过,那些人都和Cher本人没什么关系。

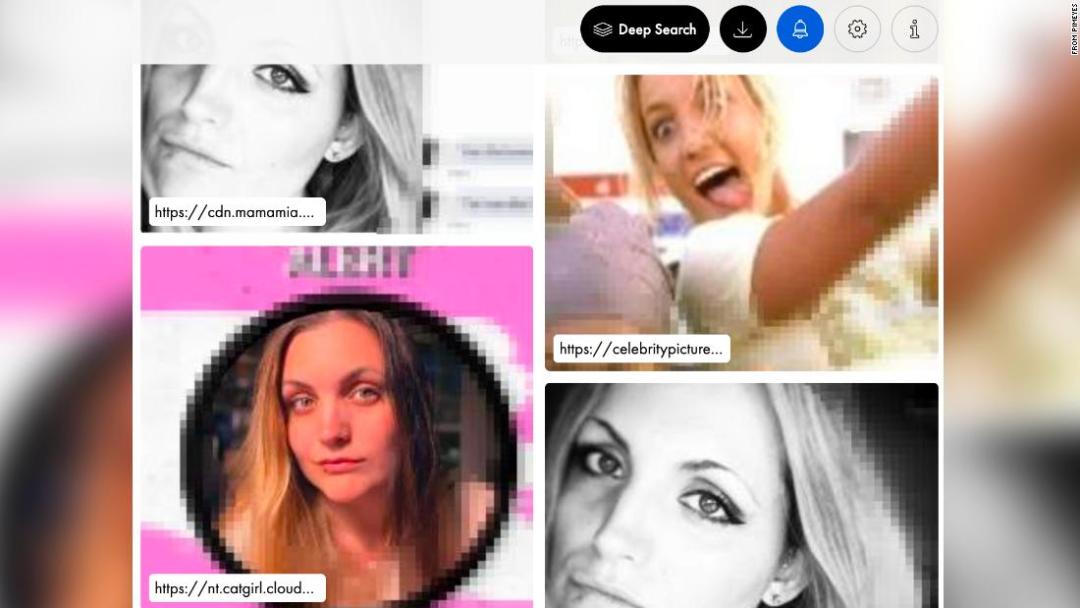

最后,Cher上传了几张自己的照片,她很好奇会不会搜出家中其他亲戚,

结果又一次让她失望,她看到的只有自己的一些近照,以及系统误认的布兰妮和她妹妹Jamie Lynn的照片,

夹在其中的,还有一个年轻女孩,

这让Cher感到困惑极了,

照片上那张青涩的脸,的确属于自己,

但是什么时候拍的呢?她一点都想不起来了。

起初,她以为自己被人用软件换了脸,

但仔细看,照片上的年轻女孩有着一头深棕色的头发,梳着中分发型,

身穿一件绿背心,戴着一条银色的项链,

这的的确确是Cher曾经的打扮,无论是衣服、发型还是首饰,她全都记得。

但照片到底是在哪拍的呢?

Cher毫无头绪,只得交上30美元会费,获取原网页的链接,

点进去后,Cher大惊失色,转到的竟然是色情网站…..

她依旧满头问号,被人换脸的疑虑盘旋在脑海中,

但随着看到的照片越来越多,那些曾让她无比痛苦的回忆全部涌了回来….

19岁时,Cher初到纽约,

当时她曾被人胁迫,拍下了一系列带有羞辱性和暴力的性行为片段,

这些事情给她带来了巨大的创伤,

那之后的几周,她甚至一度尝试过自杀。

可能是因为太过痛苦,催生了身体的自我保护机制,

10几年过后,这段黑暗的时光,已经被Cher的记忆自动抹除,

如果不是突然看到照片,她恐怕一辈子都不会再想起。

而且,她本就是一个在成长中历经艰辛的人,

童年时,Cher就遭受过性虐待,高中时又被迫辍学,和毒瘾作斗争,

裸照还在她不知情的情况下被传得满天飞….

现在,Cher住在华盛顿州的柯克,一边抚养女儿长大,一边努力戒毒,

她一直在努力克服过去的创伤,

但是,就因为点了几下鼠标,

近20年前发生过的噩梦又重新回到了她的生活之中,

让她再一次受到了巨大的侵害……

由于年代已久,照片早就被发的到处都是,

当Cher把那张年轻时的照片放进搜索框时,几十张更加露骨的图片弹了出来,

其中一些来源于专门的重口味色情片网站,还被打上了“虐待”、“窒息”、“酷刑”等关键字。

“这就像……我一半的大脑想要隐藏什么,另一半大脑正在看着什么,而且这一半知道事情是真的。

它们在我的脑海里相互碰撞,没有什么事再被隐藏。”

当Cher描述看到这些照片的感觉时,她模拟出一种头脑爆炸的声音,

只一瞬间,她就意识到,自己对纽约时光的回忆和这些照片完全不是一回事….

Cher不仅更清晰地看到在自己身上发生了什么,

她还知道,只要有任何人用这个人脸识别网站搜索她,都可以看到这些照片。

它们或许已经被印成了DVD或者VHS录像带,四处传播。

她的第一反应就是要删掉这些照片,

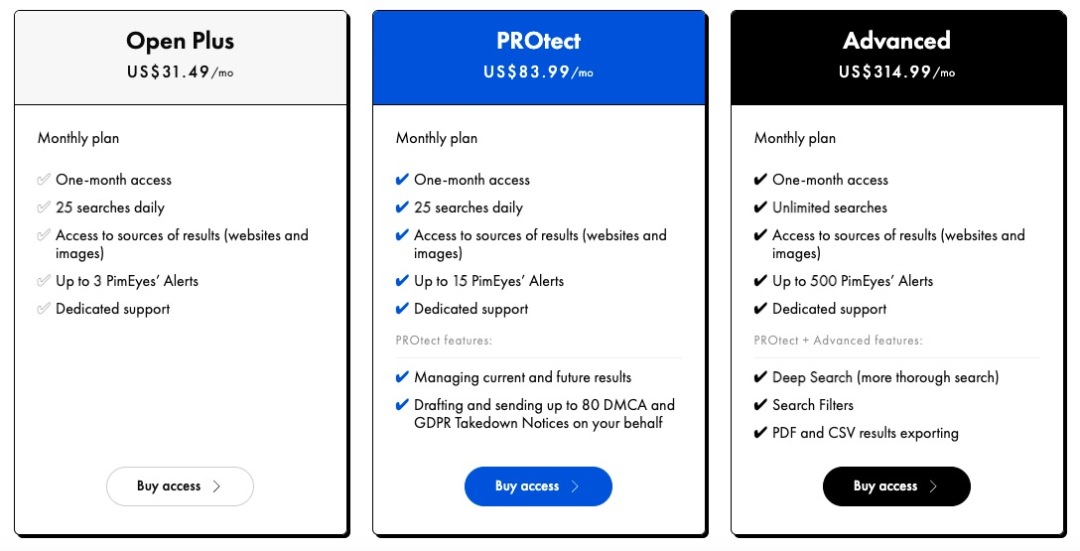

很快,Cher便将她的30美元套餐升级成80美元,

因为在更贵的套餐里,包含着一项服务,可以允许用户“管理”他们的搜索结果,比如说可以隐藏一些被搜索出的图片。

Cher的确获得了申请隐藏结果的通道,

但发出申请之后,对方却以她不是照片的“版权所有者”为求,忽略了她的请求,

即便她填写了详细的个人信息表格,上传了清晰的人脸照片,也用身份证和护照来证明自己的身份,事情依旧没有得到解决。

4月初,Cher再度付费,将网站服务升到了最高级,每月300美元,

这允许她对照片进行更深入的搜索,但除了发现更多自己的露骨照片,Cher似乎没有什么其他收获。

“简单说吧,‘我不想看到这些照片’或者‘我不想看到问题’并不能使问题真正消失。

又不光这一个搜索引擎可以找到这些照片,问题出在照片本身,而且有一些人在故意地不停上传。”Cher说。

如今,她又一次从创伤中振作起来,

呼吁人们对于人脸识别软件重新进行审视,观察它在让人失去匿名性中都起了什么作用,

“一旦失去这种匿名性,只要有人把我们的脸拍了下来,就可以搜索到我们在互联网和视频中的所有痕迹,这会产生深远的影响。”

“我们需要踩下急刹车,好好看看现在的技术,尤其是这种技术,然后问问自己‘我们都在做什么?’,‘我们对它的监管是否足够?’”Cher发问到。

如今,人脸识别网站已经作出回应,表示他们正在进行更新,

升级后,用户要求网站删除搜索结果的选项将会更加容易找到,而且无需付费就能完成这项请求。

但直到现在,那些让Cher痛苦的照片依旧漂浮在搜索结果的首页,

而且在未来,毫无疑问,会有越来越多的人,拥有和Cher一样的经历……